Esse é para quem também está estudando interfaces controladas por movimentos do corpo (leia-se “Kinect e suas variantes”).

Quando as interfaces touch começaram a se popularizar nos smartphones, bibliotecas foram criadas para ajudar os Designers de Interação no processo de desenho dessas interfaces.

O mesmo vem acontecendo com as interações gestuais sem toque, ou “touch-free gestures“:

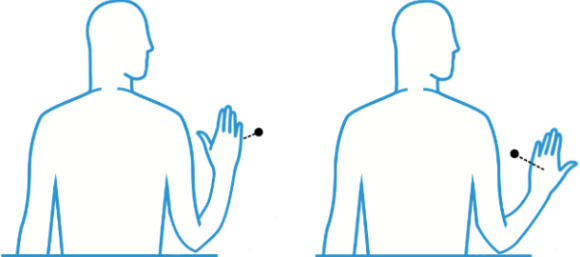

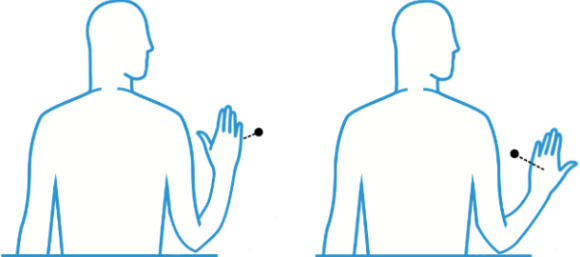

Swipe, Spread e Squeeze, os movimentos de controle mais comuns nesse tipo de sistema

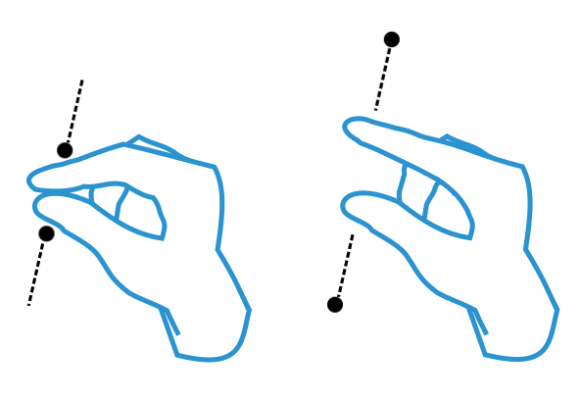

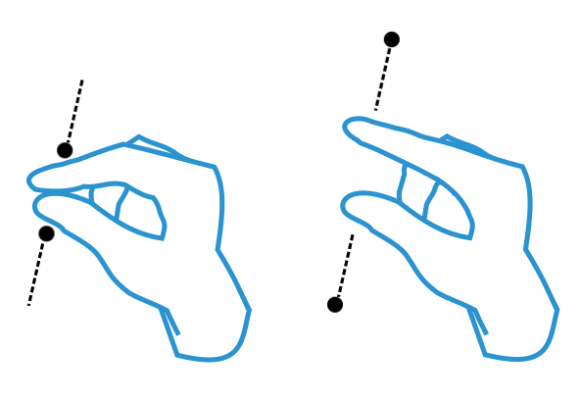

Push e Pull, para aproximar ou afastar objetos que estejam aparecendo na interface

Grasp e Release, usado para que o usuário “agarre” objetos na interface e depois use os outros gestos para movê-lo

É claro que isso é só um aperitivo. Aqui neste artigo da UXmag tem mais uma porção de gestos diferentes.

O que torna as coisas um pouco mais complicadas para o Designer de Interação (e simples para as pessoas) é que elas podem combinar os gestos das mãos com breves instruções em voz. A “conversa” com a interface fica muito mais natural. Mas isso também faz com que o Designer precise prever muitos novos cenários em cada uma das telas.

O interessante é que a partir do momento em que as interações se tornam tridimensionais (é uma pessoa se movimentando em frente a um sensor, e não “encostando” em algo bidimensional), a forma como os designers documentam e especificam essas interações também muda:

Isso acaba gerando documentos cada vez menos “convencionais” em um projeto.

Por exemplo, a distância entre a tela e as mãos do usuário é relevante em muitos casos e precisa ser documentada. O mesmo para os comandos de voz. O usuário pode usar várias palavras diferentes para tentar dizer a mesma coisa – além de diferentes sotaques e diferentes entonações de voz. Para que a interface pareça natural, ela precisa estar preparada para os mais diversos cenários de uso.

À medida em que for me aprofundando mais no assunto, compartiho por aqui.

Pronto para encarar mais essa? :)